¿Puede una IA crear otra IA? Así funciona la revolución tecnológica

Descubre cómo la inteligencia artificial está empezando a diseñar y entrenar nuevos modelos por sí sola, qué tecnologías lo hacen posible y qué implicaciones éticas y técnicas debemos afrontar en esta nueva era de autonomía algorítmica.

En el mundo acelerado de la inteligencia artificial, una de las preguntas más provocadoras y, a la vez, más fascinantes que nos hacemos en iartificial.blog es: ¿puede una IA desarrollar otra IA?

Esta interrogante no solo plantea retos técnicos, sino también dilemas éticos, filosóficos y sociales de gran calado. Y lo más inquietante de todo es que, en cierta medida, ya está ocurriendo.

En este artículo exhaustivo vamos a analizar con profundidad esta idea: cómo las IA auto-generativas están cambiando el panorama tecnológico, qué tecnologías hacen posible esta evolución, y hasta dónde puede llegar esta cadena de creación algorítmica.

¿Estamos ante un punto de inflexión donde la inteligencia artificial se convierte en autora de su propia especie?

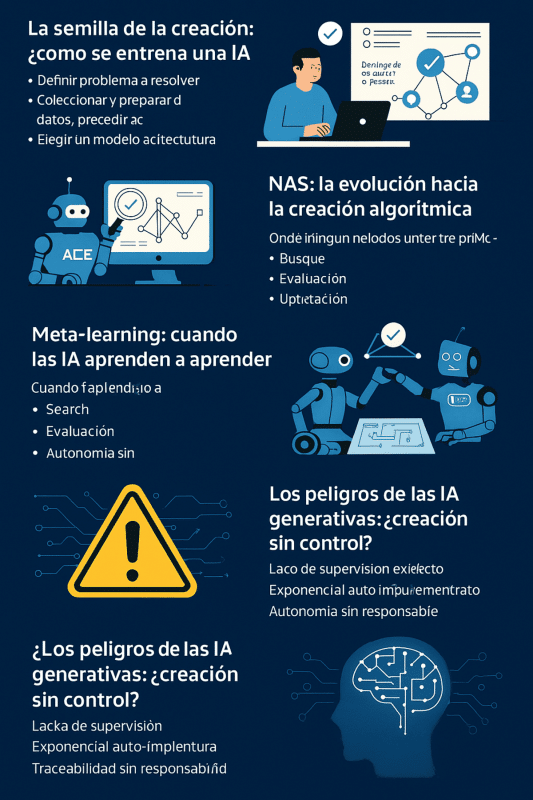

- La semilla de la creación: ¿cómo se entrena una IA?

- AutoML: el primer paso hacia la autonomía de las máquinas

- NAS: la evolución hacia la creación algorítmica

- Meta-learning: cuando las IA aprenden a aprender

- ¿Qué papel juegan los modelos fundacionales?

- ¿Puede una IA llegar a ser totalmente autónoma en la creación de otras IA?

- Los peligros de las IA generativas: ¿creación sin control?

- ¿Y qué dice la comunidad científica?

- ¿Nos dirigimos hacia una singularidad tecnológica?

- ❓ Preguntas frecuentes sobre IA que crea otras IA

La semilla de la creación: ¿cómo se entrena una IA?

Para comprender si una IA puede construir otra, primero debemos entender cómo nace una IA tradicionalmente. El proceso de creación de un modelo de inteligencia artificial implica varios pasos:

Este flujo de trabajo, típicamente humano, ha empezado a ser automatizado gracias al auge del AutoML (Automated machine learning), una de las primeras puertas hacia las IA que crean IA.

AutoML: el primer paso hacia la autonomía de las máquinas

El concepto de AutoML ha ganado fuerza en los últimos años. Se trata de un conjunto de técnicas y herramientas que automatizan las etapas más complejas del desarrollo de modelos de machine learning, como la selección de algoritmos, el diseño de arquitecturas de red, el fine-tuning de hiperparámetros o la validación cruzada.

Entre los ejemplos más destacados encontramos:

Estos sistemas no solo automatizan el proceso: lo hacen mejorando el rendimiento en muchos casos. En términos prácticos, una IA basada en AutoML puede diseñar modelos más eficientes, precisos y rápidos que los creados por científicos de datos humanos.

NAS: la evolución hacia la creación algorítmica

Una de las tecnologías más avanzadas en esta línea es el Neural Architecture Search (NAS).

Este enfoque lleva la automatización a un nuevo nivel: la IA no solo ajusta parámetros, sino que diseña nuevas arquitecturas neuronales desde cero.

El NAS funciona bajo tres principios clave:

El resultado es un sistema de inteligencia artificial que actúa como diseñador, ingeniero y evaluador de otros modelos de IA.

Un ejemplo emblemático es EfficientNet, una arquitectura diseñada mediante NAS por investigadores de Google.

Este modelo no solo superó a muchos de sus predecesores en precisión, sino que también redujo considerablemente el número de parámetros, lo cual lo hace ideal para dispositivos móviles.

Meta-learning: cuando las IA aprenden a aprender

Otro paso fundamental en esta evolución es el llamado meta-learning o "aprendizaje a aprender".

Este enfoque permite que un sistema de IA generalice conocimientos aprendidos en tareas anteriores para resolver nuevas tareas con mayor rapidez.

En lugar de entrenar modelos desde cero, el meta-learning permite que una IA aproveche su experiencia previa para:

Esto representa un cambio radical: las IA ya no solo procesan datos, sino que desarrollan estrategias de aprendizaje. En este contexto, una IA bien entrenada en meta-learning podría diseñar modelos personalizados para problemas que nunca ha visto antes.

¿Qué papel juegan los modelos fundacionales?

En los últimos años han aparecido los llamados modelos fundacionales, como GPT, PaLM o LLaMA, que no solo ejecutan tareas, sino que pueden adaptarse, combinar habilidades y transferir conocimiento a nuevos dominios.

Estos modelos, entrenados con cantidades masivas de datos, actúan como plataformas base desde donde se pueden crear nuevas inteligencias.

El hecho de que un modelo como GPT-4 pueda generar código para entrenar otro modelo de IA, preparar datasets sintéticos y optimizar configuraciones de redes neuronales demuestra que ya estamos en una fase avanzada del desarrollo de IA auto-replicante.

Incluso existen ejemplos en los que estos modelos se utilizan para escribir scripts que lanzan nuevos entrenamientos, evalúan métricas y ajustan configuraciones, sin intervención humana.

El ciclo de diseño–evaluación–mejora, antes exclusivo del ser humano, ahora puede ser completamente automatizado.

¿Puede una IA llegar a ser totalmente autónoma en la creación de otras IA?

Aquí entramos en terreno especulativo pero fascinante. En teoría, si combinamos AutoML, NAS, meta-learning y modelos fundacionales, podríamos tener un sistema capaz de:

Este ciclo cerrado de generación y auto-mejora podría, en principio, funcionar sin intervención humana directa. Una IA completamente autónoma en la creación de otras IA no solo es posible, sino que puede estar a la vuelta de la esquina.

Los peligros de las IA generativas: ¿creación sin control?

Este futuro fascinante también viene cargado de riesgos éticos, técnicos y sociales.

Si una IA puede crear y entrenar otras IA, nos enfrentamos a varios problemas serios:

Estos desafíos exigen una gobernanza tecnológica robusta, y un nuevo marco legal, ético y filosófico para afrontar lo que podría ser la próxima revolución industrial algorítmica.

¿Y qué dice la comunidad científica?

En los foros académicos y tecnológicos más avanzados, como NeurIPS, ICLR o ICML, ya se debate activamente sobre la viabilidad y consecuencias de la IA auto-generativa.

Hay líneas de investigación específicas dedicadas a:

Es decir, no estamos ante una simple curiosidad técnica, sino ante un nuevo paradigma en la evolución de la inteligencia artificial.

¿Nos dirigimos hacia una singularidad tecnológica?

Muchos autores, como Ray Kurzweil o Nick Bostrom, han advertido de la posibilidad de una singularidad tecnológica: un punto en el cual las IA no solo se auto-mejoran, sino que su evolución escapa al entendimiento humano.

En ese escenario, la creación de IA por otras IA sería el detonante de un crecimiento exponencial y autónomo de la inteligencia artificial.

Aunque esta idea aún pertenece más al terreno de la especulación, los avances actuales están allanando el camino hacia esa posibilidad.

Las condiciones técnicas ya existen, y el ritmo de innovación en campos como reinforcement learning, machine teaching y neuroevolución está rompiendo todas las previsiones.

En definitiva, la idea de que una IA pueda crear otra IA ya no es ciencia ficción. Es una realidad en construcción, impulsada por herramientas como AutoML, NAS, y modelos fundacionales de propósito general.

Cada vez estamos más cerca de una era donde las máquinas no solo piensan, sino que diseñan nuevas formas de pensar.

Desde iartificial.blog, observamos con atención esta tendencia. Como expertos en machine learning, sabemos que esta capacidad transformará todos los sectores: desde la salud hasta la educación, desde la industria hasta el arte.

Pero también entendemos que este nuevo poder requiere responsabilidad, transparencia y, sobre todo, vigilancia activa.

El futuro de la IA no será solo creado por humanos.

También será co-diseñado por inteligencias artificiales capaces de replicarse, adaptarse y evolucionar.

La pregunta ya no es si eso es posible, sino cómo lo vamos a gestionar.

¿Estamos preparados para convivir con inteligencias que se crean a sí mismas?

❓ Preguntas frecuentes sobre IA que crea otras IA

¿Qué significa que una IA pueda crear otra IA?

Significa que, mediante herramientas como AutoML o algoritmos de búsqueda de arquitecturas neuronales (NAS), una inteligencia artificial puede automatizar el diseño, entrenamiento y validación de otros modelos de IA sin intervención humana directa.

¿Es mejor una IA creada por otra IA que una diseñada por humanos?

En muchos casos, sí. Las IA generadas automáticamente han demostrado superar a modelos tradicionales en eficiencia y precisión, gracias a que exploran un mayor número de combinaciones posibles en menos tiempo y sin sesgos humanos.

⚠️ ¿Qué riesgos implica permitir que una IA cree otras inteligencias artificiales?

Los principales riesgos incluyen la pérdida de control, la dificultad para auditar decisiones, la posibilidad de que se generen sesgos no detectados y la creación de sistemas autónomos que evolucionen sin supervisión ética adecuada.

Deja una respuesta